掌握YOLOv8实例分割的ONNX模型转换及TensorRT加速部署方法

学习TensorRT部署的原理

学习ONNX的原理

学习YOLOv8的ONNX及TensorRT加速的代码解析

你将收获

掌握YOLOv8实例分割的ONNX模型转换及TensorRT加速部署方法

学习TensorRT部署的原理

学习ONNX的原理

学习YOLOv8的ONNX及TensorRT加速的代码解析

适用人群

课程介绍

PyTorch版的YOLOv8支持高性能的实时实例分割。

TensorRT是针对英伟达GPU的加速工具。

ONNX (Open Neural Network Exchange) 作为一个开放的网络模型中间表示(IR)格式,提供了跨框架兼容性。可以方便不同的框架轻松地交换模型,有助于框架之间的互操作性。

本课程讲述如何对YOLOv8实例分割的PyTorch权重文件转成ONNX格式并进行TensorRT加速部署。

相比与直接使用TensorRT API构建推理引擎,本方法更具灵活性,可用于修改YOLOv8网络架构后的模型部署。

课程亮点包括:

实测推理速度提高2倍以上。

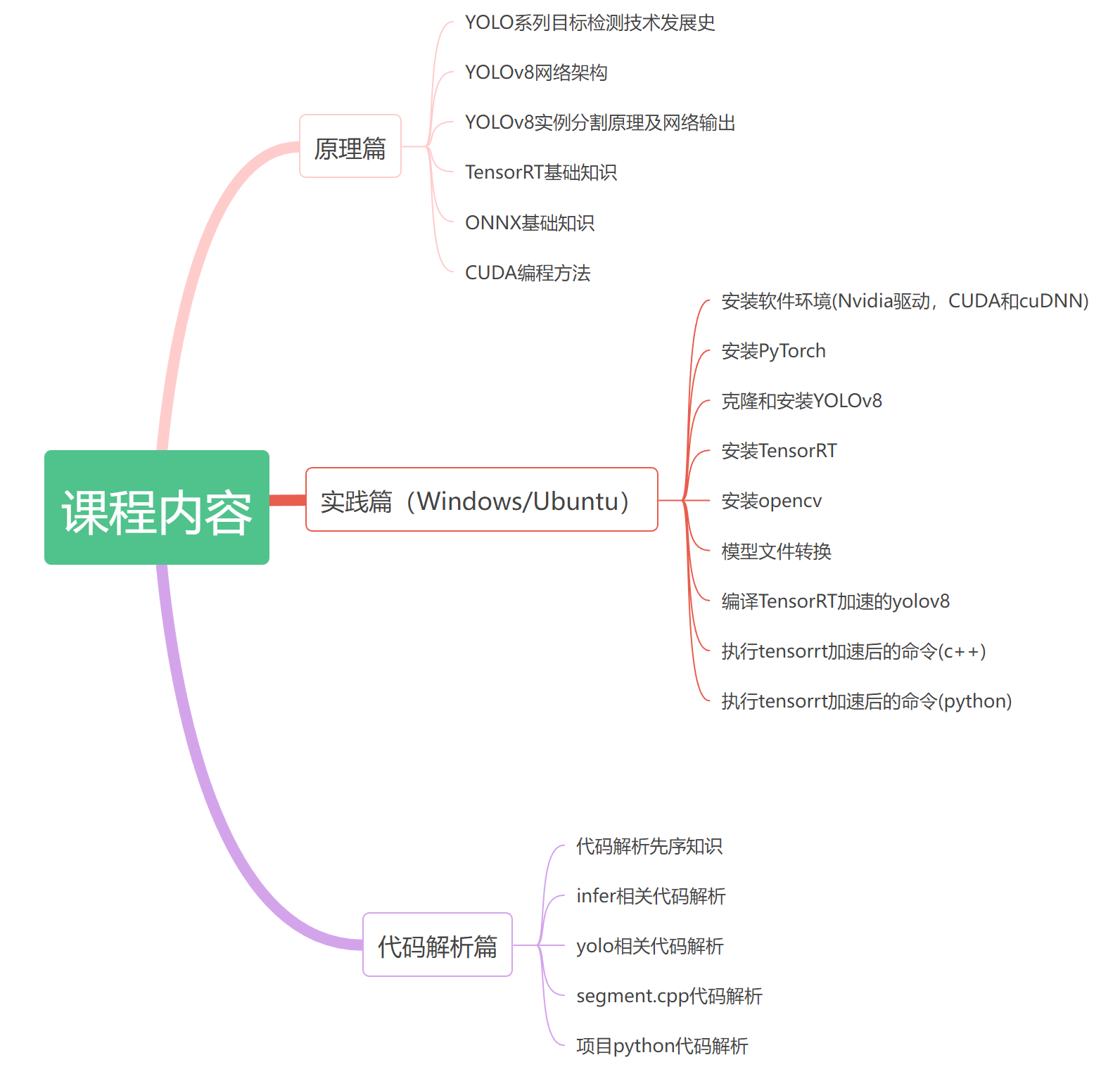

课程内容包括:

课程目录