一、课程优势

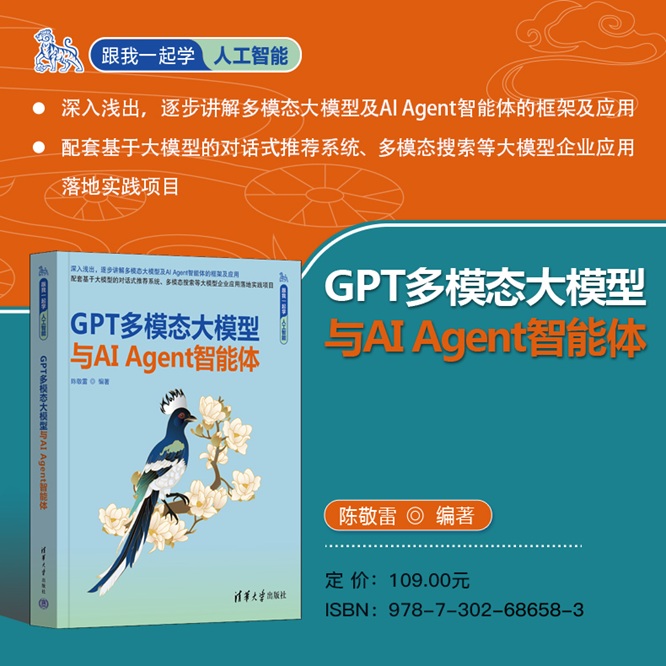

本课程有陈敬雷老师的清华大学出版社配套新书教材《GPT多模态大模型与AI Agent智能体》(跟我一起学人工智能)。

配套书籍京东自营地址:

https://item.jd.com/15073742.html

新书配合此实战课程结合学习,一静一动,互补高效学习!

本课程由互联网一线知名大牛陈敬雷老师全程亲自授课,技术前沿热门,是真正的互联网工业级实战项目。

GPT 多模态大模型、AI Agent 智能体、DeepSeek、Dify、扣子 Coze、RAG、MCP、GraphRAG、LlamaIndex、RAGFlow…… 这些 AI 圈前沿技术频繁刷屏,却让你困在碎片化信息、原理模糊、落地无门的困境里?想系统掌握从技术原理→开源框架实操→企业级落地的全链路能力,真正把 AI 技术变成可复用的生产力?

「大模型 RAG、AI 智能体、开源框架及 DeepSeek 大模型全链路操作实战课」专为你打造!课程从基础到进阶,层层递进拆解 AI 核心技术,覆盖RAG 全流程优化、多平台智能体开发、三大开源框架(RAGFlow/LlamaIndex/GraphRAG)实践、DeepSeek 企业级落地等核心板块,帮你彻底摆脱 “只会看不会做” 的窘境,从 0 到 1 掌握 AI 技术落地的硬本领。

- 技术维度全:涵盖 RAG 检索增强、AI Agent 智能体、多模态工作流、MCP 协议、三大开源框架(RAGFlow/LlamaIndex/GraphRAG)、DeepSeek 大模型微调与部署,覆盖 AI 应用核心技术栈。

- 实战场景足:从 “文档知识库搭建、智能客服工作流” 到 “多智能体协作、工业场景智能体开发”,再到 “DeepSeek 大模型企业级部署”,每个知识点配套真实业务场景实操。

- 开源框架深:深度解析 RAGFlow、LlamaIndex、GraphRAG 三大开源框架的技术原理与代码实践,让你既能 “懂原理”,又能 “改源码、做定制”。

- AI Agent 认知与核心技术:深度拆解 AI Agent 定义、角色与底层技术逻辑,帮你建立 “智能体能做什么、怎么工作” 的清晰认知;

- RAG 全流程实战:从检索增强生成的落地技巧、技术架构,到分块 / 矢量化 / 搜索索引 / 重排序等核心环节实操,再到 Agent 与 RAG 的融合、响应合成器设计,手把手教你 RAG 技术从 “理论” 到 “项目” 的转化;

- 向量数据库全覆盖:Faiss、Chroma、Pinecone、Milvus 四大向量数据库的技术原理 + 代码实践,结合 “企业私有数据知识问答、多轮对话系统” 案例,让你掌握 RAG 数据层核心能力;

- 场景化智能体开发:自主规划 Agent 操作、图文报告智能体开发,直接落地 “智能体自主决策、多模态内容生成” 等前沿应用。

- 知识库与工作流核心:从文档 / 表格知识库搭建(含 NL2SQL、ChatBI 技术),到RAG 智能客服、知识问答助手从 0 到 1 开发,再到任务 / 对话工作流对比与实操,解决 “知识管理难、AI 对话不精准” 的痛点;

- 多模态与低代码拓展:多模态大模型工作流拆解、文生图 / 文生视频 / 照片知识库实操,以及扣子 Coze 低代码建站,让你快速落地 “内容创作、智能网站” 等创新应用;

- 多智能体协作:Multi-Agents 协作实战,教你搭建 “多智能体分工协作” 的复杂系统,赋能更高效的业务自动化。

- 平台基础与架构:Dify 平台Docker/WSL 环境搭建、源码安装与核心架构拆解,让你吃透平台底层逻辑;

- 大模型与插件集成:集成 DeepSeek、通义千问等大模型底座,配置 Agent 策略与 MCP 插件,拓展平台 AI 能力边界;

- 全功能与场景化开发:平台整体功能操作、知识库管理、智能客服 / 预测类 AI 智能体开发,以及工业场景智能制造智能体落地,覆盖 “通用 + 垂直” 多类业务场景;

- 代码执行与工作流:Dify 代码执行节点环境配置、AI 智能体工作流从 0 到 1 开发,打通 “代码能力 + 智能体自动化” 的全流程。

- MCP Server 开发:服务器发送事件(SSE)、可流式传输 HTTP(StreamableHttp)的代码实践,掌握实时数据交互核心技术;

- MCP Client 与平台集成:MCP Client 开发,以及与 Cherry Studio、Dify 平台的集成,实现 “客户端 - 服务器 - 应用平台” 的全链路数据打通。

- 本地部署与自托管:Ollama 框架详解、DeepSeek 大模型本地部署全流程,Open WebUI 自托管 AI 平台功能与应用,解决 “数据隐私、云端依赖” 问题;

- 模型微调与优化:基于 Unsloth 的 DeepSeek 训练微调、DeepSeek-R1 训练微调代码实践、模型文件全解析,让你掌握 “大模型适配垂直场景” 的核心技能;

- 企业级落地:本地部署运行 DeepSeek-R1 满血版大模型,直接支撑企业级 AI 应用的高性能需求。

从文档预处理、文本分块、向量化,到元数据优化、多级索引、查询改写,再到重排模型、提示词优化,12 项优化策略覆盖 RAG 落地全流程,教你解决 “检索不准、速度慢、大模型输出差” 等核心痛点,让 RAG 项目真正 “好用、能用、落地顺畅”。

- 原理与部署:RAGFlow 技术原理与系统架构解析,多环境安装部署与整体功能操作,为实操筑牢基础;

- 场景化应用:知识库构建、聊天助手开发、智能体工作流搭建,快速落地 “知识问答、流程自动化” 等场景,体验 RAGFlow 在检索增强中的高效性。

- 技术与代码:LlamaIndex 技术原理与系统架构拆解,多源数据加载、索引创建、大模型集成的代码实战,让你掌握 “打破大模型数据孤岛” 的核心工具。

解析 GraphRAG“图数据结构 + 检索增强生成” 的创新技术原理,通过实战案例演示图构建、知识图谱与 RAG 融合、检索增强调优,为大模型引入 “图级知识关联与推理” 能力,拓展复杂知识场景的应用边界。

- 全链路覆盖,技术无死角:从 RAG、AI Agent、多模态,到三大开源框架、DeepSeek 大模型,覆盖 AI 应用从 “底层技术” 到 “企业落地” 的全链路知识。

- 实战驱动,学完即能用:每个知识点配套代码实践、场景案例,从 “环境搭建、功能操作” 到 “项目开发、优化策略”,全程落地导向,避免 “纸上谈兵”。

- 聚焦开源,贴合行业趋势:深度拆解 RAGFlow、LlamaIndex、GraphRAG 等开源框架,契合企业 “基于开源做定制、降本提效” 的技术选型趋势。

- 作者权威,内容经检验:作者陈敬雷深耕 AI 领域多年,内容基于《GPT 多模态大模型与 AI Agent 智能体》理论沉淀,结合大量企业级项目实践经验,理论与实战深度融合。

无论你是 AI 新手想系统入门,还是从业者想突破技术瓶颈、落地 AI 项目,这门课都能帮你精准卡位 AI 技术浪潮,把 “前沿技术” 变成 “可落地的生产力”。

三、老师介绍

陈敬雷 充电了么创始人,CEO兼CTO

陈敬雷,北京充电了么科技有限公司创始人,CEO兼CTO,十几年互联网从业经验,曾就职于用友网络、中软集团、凡客诚品、唯品会、猎聘、人民日报(灵思云途)、北京万朝科技,曾任架构师、首席技术官、首席科学家等职务,对业务领域B端、C端、电商、职场社交招聘、内容文娱、营销行业都有着丰富的经验,在技术领域,尤其在大数据和人工智能方向有丰富的算法工程落地实战经验,其中在猎聘任职期间主导的推荐算法系统项目获得公司优秀项目奖,推荐效果得到5倍的提升。

此外,陈敬雷著有清华大学出版社四本人工智能书籍,分别是《分布式机器学习实战》《自然语言处理原理与实战》《GPT多模态大模型与AI Agent智能体》《DeepSeek大模型与具身智能实践》,颇受好评。同时陈敬雷还是知名大数据人工智能讲师,研发了上百门课程,总计有30万学员。

四、《GPT多模态大模型与AI Agent智能体》书籍配套视频课程介绍:

陈敬雷老师的京东自营书名标题: GPT多模态大模型与AI Agent智能体(跟我一起学人工智能)

《GPT多模态大模型与AI Agent智能体》(跟我一起学人工智能)是一本2025年清华大学出版社出版的图书,作者是陈敬雷,本书深入探讨了GPT多模态大模型与AI Agent智能体的技术原理及其在企业中的应用落地。

全书共8章,从大模型技术原理切入,逐步深入大模型训练及微调,还介绍了众多国内外主流大模型。LangChain技术、RAG检索增强生成、多模态大模型等均有深入讲解。对AI Agent智能体,从定义、原理到主流框架也都进行了深入讲解。在企业应用落地方面,本书提供了丰富的案例分析,如基于大模型的对话式推荐系统、多模态搜索、NL2SQL数据即席查询、智能客服对话机器人、多模态数字人,以及多模态具身智能等。这些案例不仅展示了大模型技术的实际应用,也为读者提供了宝贵的实践经验。

本书适合对大模型、多模态技术及AI Agent感兴趣的读者阅读,也特别适合作为高等院校本科生和研究生的教材或参考书。书中内容丰富、系统,既有理论知识的深入讲解,也有大量的实践案例和代码示例,能够帮助学生在掌握理论知识的同时,培养实际操作能力和解决问题的能力。通过阅读本书,读者将能够更好地理解大模型技术的前沿发展,并将其应用于实际工作中,推动人工智能技术的进步和创新。

五、配套书籍目录:

第1章 大模型技术原理

1.1 大模型技术的起源、思想

1.2 基于Transformer的预训练语言模型

1.2.1 编码预训练语言模型

1.2.2 解码预训练语言模型

1.2.3 基于编解码架构的预训练语言模型

1.3 提示学习与指令微调

1.3.1 提示学习

1.3.2 指令微调

1.4 人类反馈强化学习

1.4.1 强化学习

1.4.2 PPO算法

1.4.3 大模型人类反馈强化学习对齐

1.5 GPT智能涌现原理与AGI通用人工智能

1.5.1 什么是智能涌现

1.5.2 思维链

1.5.3 上下文学习能力

1.5.4 指令理解

1.5.5 通用人工智能

第2章 大模型训练及微调

2.1 大模型训练概述

2.2 分布式训练的并行策略

2.2.1 数据并行

2.2.2 模型并行

2.2.3 混合并行

2.2.4 并行计算框架

2.3 预训练模型的压缩

2.3.1 模型压缩方案概述

2.3.2 结构化模型压缩策略

2.3.3 非结构化模型压缩策略

2.3.4 8位/4位量化压缩实战

2.4 大模型微调方法

2.4.1 Prefix Tuning微调

2.4.2 P-Tuning V1微调

2.4.3 P-Tuning V2微调

2.4.4 LoRA微调

2.4.5 QLoRA微调

2.5 基于旋转位置编码RoPE的长文本理解

2.5.1 RoPE技术原理

2.5.2 RoPE关键特性

第3章 主流大模型

3.1 国内大模型

3.1.1 智谱清言ChatGLM

3.1.2 百川智能

3.1.3 百度文心一言

3.1.4 阿里巴巴通义千问

3.1.5 腾讯混元

3.1.6 华为盘古

3.1.7 360智脑

3.1.8 科大讯飞星火

3.1.9 智源悟道大模型

3.1.10 月之暗面Kimi

3.1.11 复旦大学MOSS

3.1.12 零一万物

3.1.13 字节跳动豆包大模型

3.2 国外大模型

3.2.1 OpenAI GPT-4o

3.2.2 Meta LLaMA

3.2.3 Anthropic Claude

3.2.4 谷歌Gemini和开源Gemma

3.2.5 Mistral Large

3.2.6 xAI Grok

3.3 垂直类大模型

3.3.1 HuatuoGPT

3.3.2 BianQue

3.3.3 BenTsao

3.3.4 XrayGLM

3.3.5 DoctorGLM

3.3.6 ChatMed

3.3.7 度小满轩辕

3.3.8 BloombergGPT

3.3.9 LawGPT

3.3.10 LexiLaw

3.3.11 Lawyer LLaMA

3.3.12 ChatLaw

3.3.13 ChatGLM-Math

第4章 LangChain技术原理与实践

4.1 LangChain技术原理

4.2 LangChain六大核心模块

4.2.1 模型I/O

4.2.2 数据增强模块

4.2.3 链模块

4.2.4 记忆模块

4.2.5 Agent模块

4.2.6 回调处理器

第5章 RAG检索增强生成

5.1 RAG技术原理

5.1.1 RAG的概念与应用

5.1.2 RAG技术架构

5.1.3 分块和向量化

5.1.4 搜索索引

5.1.5 重新排序和过滤

5.1.6 查询转换与路由

5.1.7 RAG中的Agent智能体

5.1.8 响应合成器

5.1.9 大模型微调和RAG优劣势对比

5.2 文本向量模型

5.2.1 Embedding模型、Reranker模型及ColBERT模型

5.2.2 阿里巴巴GTE向量模型

5.2.3 中文acge_text_embedding模型

5.2.4 智源中英文语义向量模型BGE

5.2.5 Moka开源文本嵌入模型M3E

5.2.6 OpenAI的text-embedding模型

5.3 向量数据库

5.3.1 Faiss

5.3.2 Milvus

5.3.3 Pinecone

5.3.4 Chroma

5.4 RAG应用实践

5.4.1 基于大模型构建企业私有数据的知识问答

5.4.2 应对大模型落地挑战的优化策略

第6章 多模态大模型

6.1 多模态基础模型

6.1.1 多模态对齐、融合和表示

6.1.2 CLIP

6.1.3 BLIP

6.1.4 BLIP-2

6.1.5 InstructBLIP和X-InstructBLIP

6.1.6 SAM

6.1.7 OpenFlamingo

6.1.8 VideoChat

6.1.9 PaLM-E

6.2 OpenAI多模态大模型DALL·E 3、GPT-4V、GPT-4o、Sora

6.2.1 文生图多模态大模型DALL·E 3

6.2.2 GPT-4V

6.2.3 端到端训练多模态大模型GPT-4o技术原理

6.2.4 文生视频多模态大模型Sora

6.3 通义千问多模态大模型

6.3.1 开源Qwen-VL和Qwen-VL-Chat

6.3.2 Qwen-VL-Plus和Qwen-VL-Max

6.4 开源端到端训练多模态大模型LLaVA

6.4.1 LLaVA

6.4.2 LLaVA-1.5

6.4.3 LLaVA-1.6

6.4.4 MoE-LLaVA

6.4.5 LLaVA-Plus

6.4.6 Video-LLaVA和LLaVA-NeXT-Video

6.5 零一万物多模态大模型Yi-VL系列

6.5.1 Yi-VL系列模型架构

6.5.2 Yi-VL系列模型训练微调及推理

6.6 清华系多模态大模型

6.6.1 VisualGLM-6B

6.6.2 CogVLM2

6.6.3 CogAgent

6.6.4 CogView、CogVideo和CogVideoX

6.6.5 CogCoM

6.6.6 GLM-4V-9B

第7章 AI Agent智能体

7.1 AI Agent智能体介绍和原理

7.1.1 AI Agent的定义与角色

7.1.2 AI Agent技术原理

7.2 主流大模型Agent框架

7.2.1 AutoGPT

7.2.2 MetaGPT

7.2.3 ChatDev

7.2.4 AutoGen

7.2.5 FastGPT

7.2.6 XAgent

7.2.7 GPT-Engineer

7.2.8 BabyAGI

7.2.9 SuperAGI

第8章 大模型在企业应用中落地

8.1 基于大模型的对话式推荐系统

8.1.1 基于大模型的对话式推荐系统技术架构设计

8.1.2 推荐AI Agent智能体

8.1.3 面向推荐的语言表达模型

8.1.4 知识插件

8.1.5 基于大模型的推荐解释

8.1.6 对话式推荐系统的新型评测方法

8.2 多模态搜索

8.2.1 多模态搜索技术架构设计

8.2.2 多模态搜索关键技术

8.2.3 多模态实时搜索与个性化推荐

8.3 基于自然语言交互的NL2SQL数据即席查询

8.3.1 NL2SQL数据即席查询技术原理

8.3.2 NL2SQL应用实践

8.4 基于大模型的智能客服对话机器人

8.4.1 大模型智能客服对话机器人技术原理

8.4.2 AI大模型赋能提升智能客服解决率新策略

8.4.3 基于大模型的智能客服对话机器人系统搭建

8.5 多模态数字人

8.5.1 多模态数字人技术原理

8.5.2 三维建模与三维重建

8.5.3 数字人形象设计

8.5.4 唇形同步算法

8.5.5 NeRF、ER-NeRF与RAD-NeRF模型

8.5.6 数字人项目实践

8.6 多模态具身智能

8.6.1 多模态具身智能概念及技术路线

8.6.2 多模态感知与场景理解

8.6.3 视觉导航

8.6.4 世界模型

8.6.5 具身智能模拟器

8.6.6 多模态多感官交互具身智能大模型

8.6.7 端到端强化学习人形机器人

8.6.8 多模态通才具身智能体