Llama3大模型原理代码精讲与部署微调评估实战

课时介绍

课程介绍

本课程了有关Transformer和大语言模型(LLM)的关键前置知识, 包括注意力机制、多头注意力、编码器-解码器结构等Transformer原理, 以及LLM的文本生成和LLM微调技术原理。

在此基础上, 重点介绍了Llama 3模型的进化历程、技术原理和代码实现。其中涉及RMSNorm归一化、SwiGLU激活函数、RoPE位置编码、GQA注意力和KVCache等关键技术。通过代码解析, 深入剖析了Llama 3的架构设计和代码实现。

在实践部分, 课程还介绍了如何在阿里云使用Ollama和vLLM部署Llama 3模型, 以及使用llama_factory工具进行基于LoRA和QLoRA的llama3 8B大模型微调。项目实战环节则提供了从准备数据集到训练、推理、评估的全流程指导, 聚焦中文增强和医疗问答两大应用方向。

这是一门内容全面、理论实践并重的大模型课程。不仅系统讲解了LLM和Llama 3的技术原理, 还通过代码解析和实战项目深度剖析了相关技术在工程落地中的关键环节, 有助于学员全面掌握大模型相关知识和动手实战能力。

-------------------------------------------------------------------------------

具体课程内容如下:

前置知识1:Transformer原理与代码精讲

- 注意力机制:了解注意力机制如何使模型能够捕捉输入序列中不同位置之间的相关性。

- 自注意力:解释自注意力如何允许序列的每个元素都与序列中的其他元素进行交互。

- 多头注意力:探讨多头注意力如何通过并行处理多个注意力层来增强模型的能力。

- 位置编码:学习位置编码如何为模型提供序列中单词的位置信息。

- 编码器和解码器:深入分析Transformer的编码器和解码器结构,以及它们在模型中的作用。

- 层归一化(LayerNorm)和前馈网络(FFN):介绍这两种技术如何帮助稳定和增强模型的训练过程。

- 代码精讲:讲解Transformer模型的PyTorch代码实现细节等。

前置知识2:大模型(LLM)文本生成

- LLM的推理方式

- LLM的文本生成模式: 主要有Completion模式和Chat模式两种

- LLM的文本生成策略: 包括贪婪搜索、束搜索、随机采样、温度采样、Top-k采样和Top-p采样等

- LLM中的Token与分词器

- llama3的文本生成过程

- LLM文本生成的预填充和解码阶段

- LLM文本生成中的Q、K、V机制

前置知识3:大模型微调原理

- LLM的开发流程可分为预训练、有监督微调、奖励建模和强化学习四个阶段

- 从基座模型到对话模型的转变。

- 针对特定领域的SFT微调

- 微调的技术方法包括全参微调、冻结微调、LoRA、QLoRA

- LoRA技术原理和有效性

- QLoRA技术原理

Llama3进化史和生态

Llama3原理精讲

- Llama3模型架构

- RMSNorm归一化技术

- SwiGLU激活函数

- RoPE旋转位置编码

- GQA分组查询注意力

- KVCache

Llama3代码解析

- 各文件功能

- completion和chat应用脚本代码解析

- generation.py代码解析

- model.py代码解析

- tokenizer.py代码解析

- RMSNorm代码解析

- SwiGLU代码解析

- GQA代码解析

- RoPE代码解析

- KVCache代码解析

Llama3部署

- Ollama部署llama3-阿里云免费GPU算力领取及实例创建、ollama安装、llama3推理

- VLLM部署llama3

Llama3项目实战1-llama_factory微调llama3中文增强大模型

- llama_factory介绍

- llama_factory安装及llama3模型下载

- LoRA微调训练llama3 8B Instruct模型

- llama3中文增强大模型推理

- llama3中文增强大模型评估(MMLU, CEVAL, CMMLU)

- LoRA文件合并

Llama3项目实战2-llama_factory微调llama3医疗问答大模型(LoRA)

- 准备医疗问答大模型数据集

- LoRA微调训练llama3 8B Instruct模型

- llama3医疗问答大模型推理

Llama3项目实战3-llama_factory微调llama3医疗问答大模型(QLoRA)

- QLoRA微调训练llama3 8B Instruct模型

- llama3医疗问答大模型推理

-----------------------------------------------------------------------------------

购课后可加入课程学习QQ群:364717673

信息系统项目管理师自考笔记

李明 · 1008人在学

python从0到1:期货量化交易系统(CTP实战,高频及合成K线数据

王先生 · 23127人在学

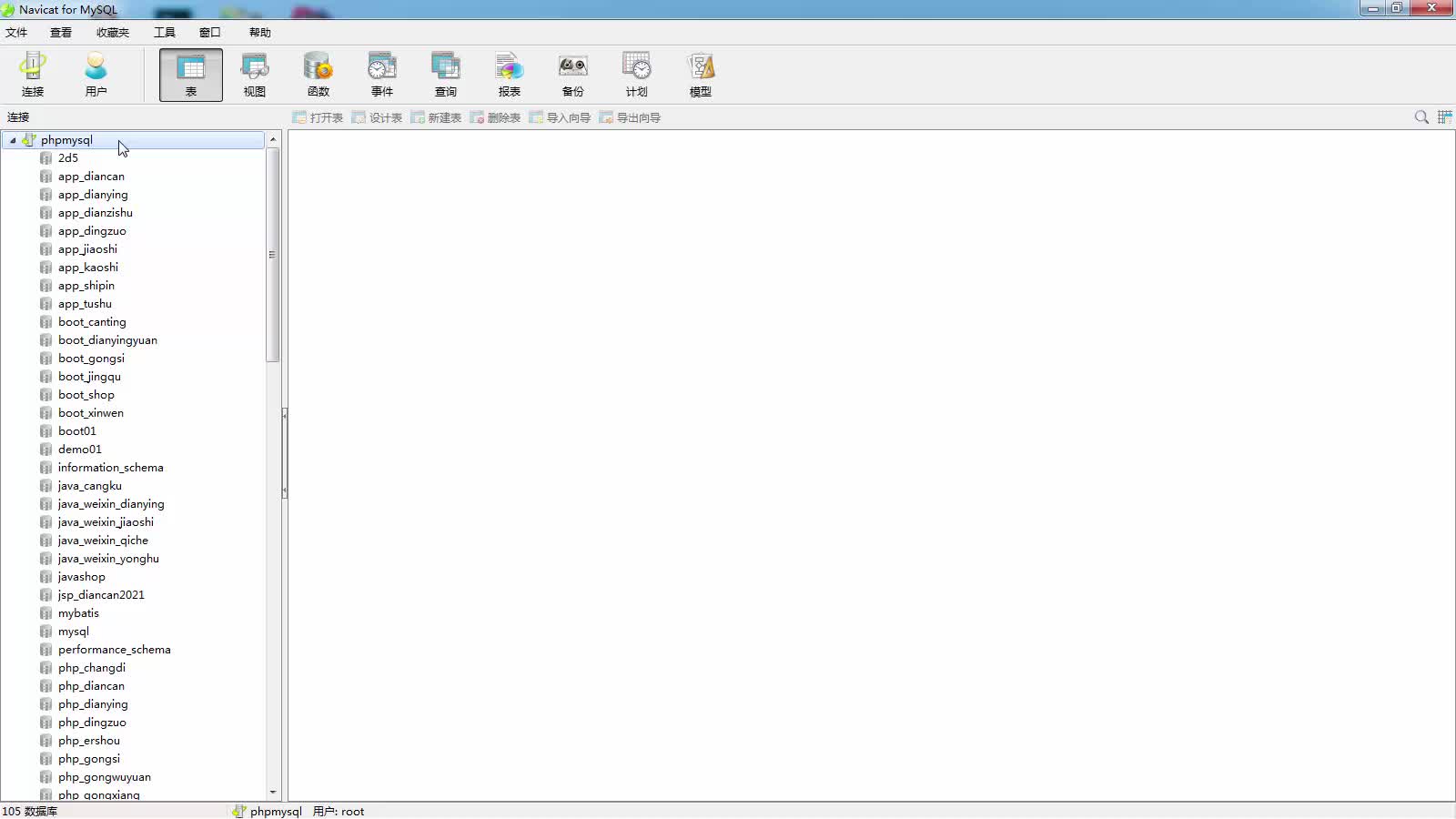

手把手搭建Java超市管理系统【附源码】(毕设)

汤小洋 · 4330人在学

Java毕设springboot外卖点餐系统 毕业设计毕设源码 使用教

黄菊华 · 856人在学

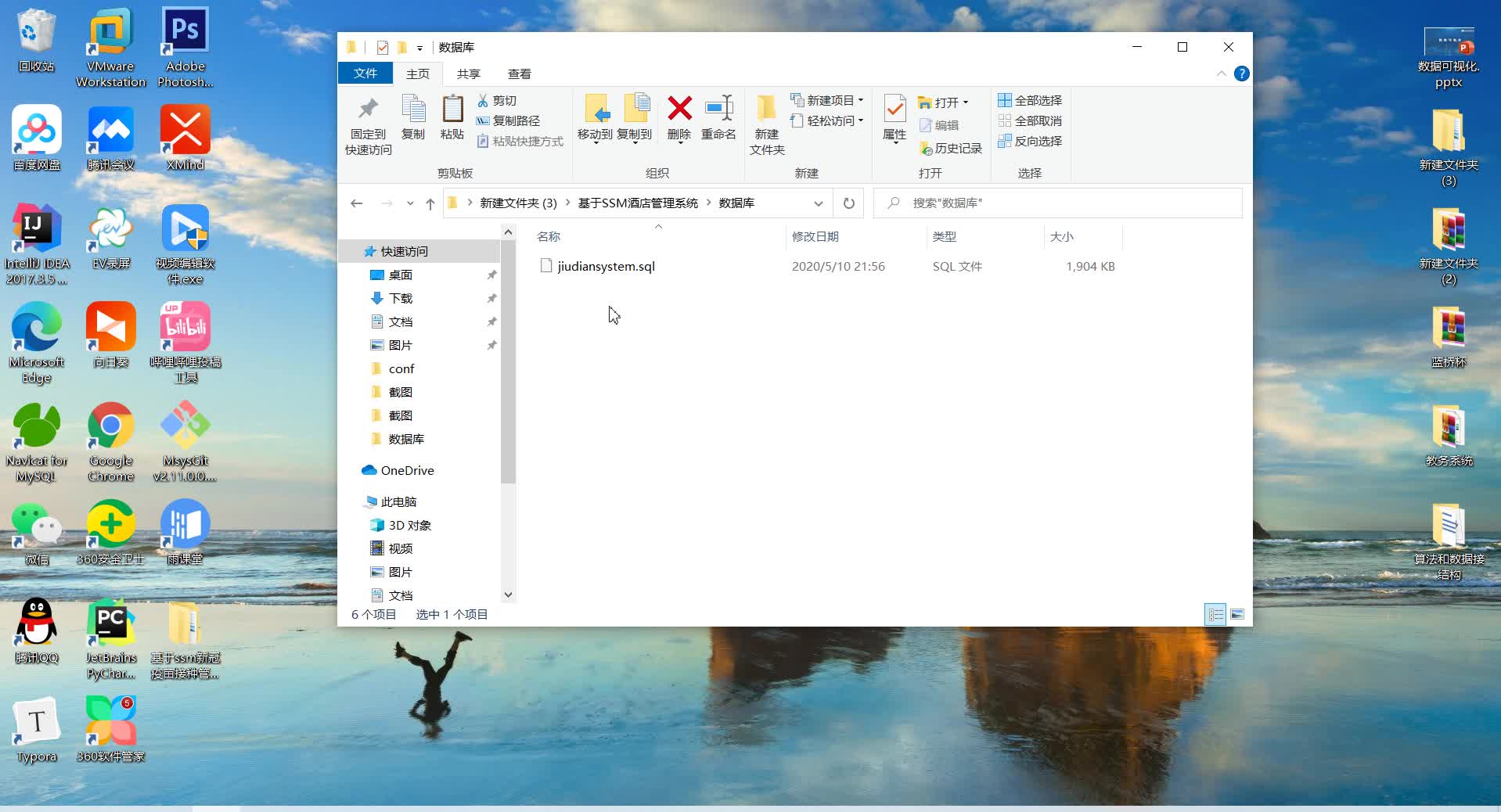

基于SSM酒店管理系统(毕设)

小尼老师 · 922人在学

java项目实战之购物商城(java毕业设计)

Long · 5223人在学

手把手搭建Java求职招聘系统【附源码】(毕设)

汤小洋 · 1546人在学

Python Django 深度学习 小程序

钟翔 · 2446人在学

城管局门前三包管理系统+微信小程序(vue+springboot)

赖国荣 · 727人在学

Vue+Uni-app(uniapp)入门与实战+赠送仿美团点餐小程序

李杰 · 4117人在学