包含课程

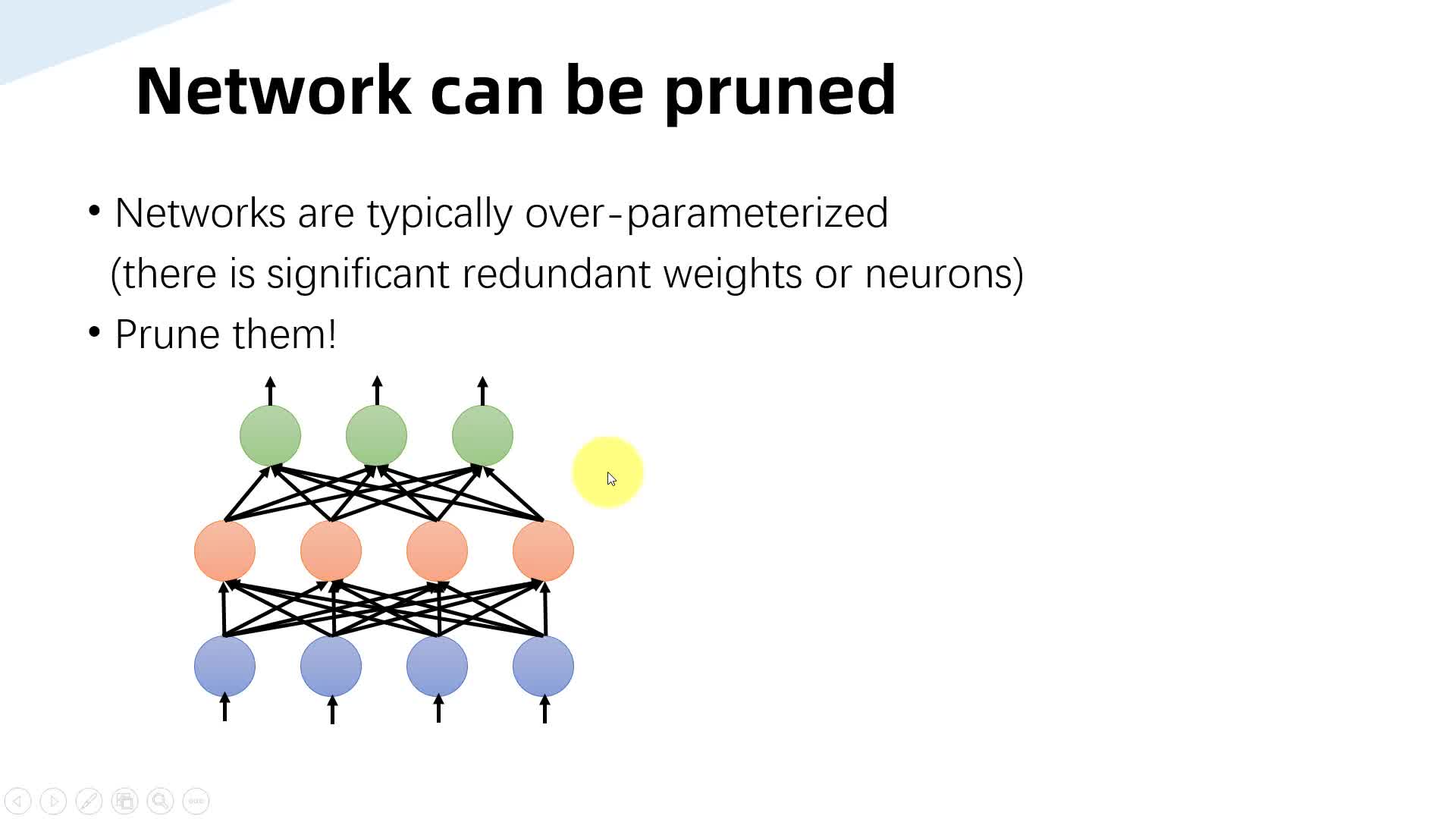

3408人 学习人数5.0分 课程评分YOLOv5目标检测之网络剪枝实战PyTorch版的YOLOv5是一个非常流行的基于深度学习的目标检测器。本课程使用Network Slimming剪枝方法对YOLOv5进行网络剪枝,使其更加轻量。Network Slimming是一种经典的实用模型压缩方法,可实现高效的通道级别的结构化剪枝。该方法通过利用BN(Batch Normalization)层中缩放因子较小的值来剪裁的相应通道,达到精简网络的目的。步骤包括:增加稀疏正则化的训练、网络模型剪枝、剪枝后的网络模型微调。本课程在YOLOv5 v6.1版本代码的基础上增加Network Slimming剪枝方法,在Windows和Ubuntu系统上演示针对自己的数据集训练和进行网络剪枝过程,并讲解原代码针对剪枝的修改部分。本课程分为原理篇、实战篇、代码讲解篇。 * 原理篇包括:网络剪枝的基础知识、Network Slimming剪枝原理。 * 实战篇包括:PyTorch环境安装、YOLOv5项目安装、准备自己的数据集、修改配置文件、正常训练自己的数据集、稀疏化训练、网络模型剪枝、剪枝后的网络模型微调。 * 代码讲解篇包括:剪枝代码修改说明和具体修改的代码讲解。yolov5计算机视觉目标检测深度学习人工智能

3408人 学习人数5.0分 课程评分YOLOv5目标检测之网络剪枝实战PyTorch版的YOLOv5是一个非常流行的基于深度学习的目标检测器。本课程使用Network Slimming剪枝方法对YOLOv5进行网络剪枝,使其更加轻量。Network Slimming是一种经典的实用模型压缩方法,可实现高效的通道级别的结构化剪枝。该方法通过利用BN(Batch Normalization)层中缩放因子较小的值来剪裁的相应通道,达到精简网络的目的。步骤包括:增加稀疏正则化的训练、网络模型剪枝、剪枝后的网络模型微调。本课程在YOLOv5 v6.1版本代码的基础上增加Network Slimming剪枝方法,在Windows和Ubuntu系统上演示针对自己的数据集训练和进行网络剪枝过程,并讲解原代码针对剪枝的修改部分。本课程分为原理篇、实战篇、代码讲解篇。 * 原理篇包括:网络剪枝的基础知识、Network Slimming剪枝原理。 * 实战篇包括:PyTorch环境安装、YOLOv5项目安装、准备自己的数据集、修改配置文件、正常训练自己的数据集、稀疏化训练、网络模型剪枝、剪枝后的网络模型微调。 * 代码讲解篇包括:剪枝代码修改说明和具体修改的代码讲解。yolov5计算机视觉目标检测深度学习人工智能

5167人 学习人数5.0分 课程评分YOLOv5目标检测之知识蒸馏实战PyTorch版的YOLOv5是一个当前非常流行的目标检测器,本课程对YOLOv5进行知识蒸馏实战,来提升其性能。知识蒸馏(Knowledge Distillation)是模型压缩的一种常用的方法。它利用性能更好的大模型的监督信息,来训练一个轻量化小模型,使小模型达到更好的性能和精度。 最早是由Hinton首次提出并应用在分类任务上,这个大模型称之为教师模型,小模型称之为学生模型。来自教师模型输出的监督信息称之为Knowledge(知识),而学生网络学习迁移来自教师网络的监督信息的过程称之为Distillation(蒸馏)。本课程在YOLOv5 v6.1版本代码的基础上增加知识蒸馏方法,并实际演示针对自己的数据集训练和进行知识蒸馏过程,并讲解原代码针对知识蒸馏的修改部分。本课程分为原理篇、实战篇、代码讲解篇。 * 原理篇包括:知识蒸馏的基础知识、目标检测中知识蒸馏的方法。 * 实战篇包括:PyTorch环境安装、YOLOv5项目安装、准备自己的数据集、修改配置文件、训练学生网络(Yolov5s)、训练教师网络(训练YOLOv5m)、知识蒸馏训练。 * 代码讲解篇包括:知识蒸馏具体修改代码的讲解。yoloYOLOv5知识蒸馏计算机视觉目标检测

5167人 学习人数5.0分 课程评分YOLOv5目标检测之知识蒸馏实战PyTorch版的YOLOv5是一个当前非常流行的目标检测器,本课程对YOLOv5进行知识蒸馏实战,来提升其性能。知识蒸馏(Knowledge Distillation)是模型压缩的一种常用的方法。它利用性能更好的大模型的监督信息,来训练一个轻量化小模型,使小模型达到更好的性能和精度。 最早是由Hinton首次提出并应用在分类任务上,这个大模型称之为教师模型,小模型称之为学生模型。来自教师模型输出的监督信息称之为Knowledge(知识),而学生网络学习迁移来自教师网络的监督信息的过程称之为Distillation(蒸馏)。本课程在YOLOv5 v6.1版本代码的基础上增加知识蒸馏方法,并实际演示针对自己的数据集训练和进行知识蒸馏过程,并讲解原代码针对知识蒸馏的修改部分。本课程分为原理篇、实战篇、代码讲解篇。 * 原理篇包括:知识蒸馏的基础知识、目标检测中知识蒸馏的方法。 * 实战篇包括:PyTorch环境安装、YOLOv5项目安装、准备自己的数据集、修改配置文件、训练学生网络(Yolov5s)、训练教师网络(训练YOLOv5m)、知识蒸馏训练。 * 代码讲解篇包括:知识蒸馏具体修改代码的讲解。yoloYOLOv5知识蒸馏计算机视觉目标检测

套餐介绍

YOLOv5剪枝与知识蒸馏

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈